Le potenzialità dell’intelligenza artificiale applicata alla professione forense sono innegabili, come innegabile è l’interesse che tali tecnologie suscitano nei professionisti del settore. E tuttavia, non ci si può esimere dal notare che, insieme alla curiosità, esiste un sentimento opposto e diffuso tra gli avvocati di diffidenza nei confronti di tali tecnologie. Infatti, la velocità con cui queste vengono sviluppate e la quantità di letteratura che commenta e analizza tali innovazioni non sembrano essere in questa fase direttamente proporzionali alla volontà degli studi legali di investire in intelligenza artificiale e di integrare concretamente quest’ultima nella propria pratica. Tale scetticismo è dovuto, in parte, ai limiti pratici delle tecnologie ad oggi a disposizione, specie se paragonati ai costi, tanto in termini di tempo quanto di risorse, richiesti per la loro adozione nella pratica forense. Come già si accennava in un precedente contributo, gli output generati dagli strumenti di intelligenza artificiale risultano spesso poco accurati e necessitano di un controllo supplementare da parte dell’avvocato. E anzi, sono le tecnologie stesse, attraverso i propri termini d’uso, ad avvertire gli utenti dell’inaffidabilità dei risultati raggiunti tramite l’intelligenza artificiale e a invitarli a fare affidamento sul giudizio informato dei professionisti, escludendo così qualsiasi responsabilità in caso di output imprecisi o completamente errati. Nessuna garanzia, dunque, da parte della macchina: al contrario, tutta la responsabilità del lavoro svolto da quest’ultima rimane sull’avvocato, che spesso difetta degli strumenti e dell’expertise per comprendere a pieno i processi che portano a un determinato output, e non è dunque in grado di esaminarne agilmente l’accuratezza se non tramite un lavoro manuale parallelo di verifica. E tuttavia, sebbene i prodotti focalizzati sugli aspetti più sostanziali del lavoro dell’avvocato non siano ancora in grado di superare questo senso di diffidenza, in quanto di fatto non creano particolare efficienza, ne esistono altri, più specifici e mirati, che sono effettivamente in grado di velocizzare quelle attività meno tecniche della professione. Ciononostante, è bene sottolineare come l’adozione di qualsiasi strumento, a prescindere dalla sua capacità di velocizzare il lavoro del professionista, debba comunque fare i conti con la peculiare personalità degli avvocati, che spesso manca di adattabilità ed è riluttante al cambiamento e all’introduzione di nuovi procedimenti che modificano il modo in cui il professionista è abituato a svolgere determinate attività. Le potenzialità dell’intelligenza artificiale applicata alla professione forense sono innegabili, come innegabile è l’interesse che tali tecnologie suscitano nei professionisti del settore. E tuttavia, non ci si può esimere dal notare che, insieme alla curiosità, esiste un sentimento opposto e diffuso tra gli avvocati di diffidenza nei confronti di tali tecnologie. Infatti, la velocità con cui queste vengono sviluppate e la quantità di letteratura che commenta e analizza tali innovazioni non sembrano essere in questa fase direttamente proporzionali alla volontà degli studi legali di investire in intelligenza artificiale e di integrare concretamente quest’ultima nella propria pratica. Tale scetticismo è dovuto, in parte, ai limiti pratici delle tecnologie ad oggi a disposizione, specie se paragonati ai costi, tanto in termini di tempo quanto di risorse, richiesti per la loro adozione nella pratica forense. Come già si accennava in un precedente contributo, gli output generati dagli strumenti di intelligenza artificiale risultano spesso poco accurati e necessitano di un controllo supplementare da parte dell’avvocato. E anzi, sono le tecnologie stesse, attraverso i propri termini d’uso, ad avvertire gli utenti dell’inaffidabilità dei risultati raggiunti tramite l’intelligenza artificiale e a invitarli a fare affidamento sul giudizio informato dei professionisti, escludendo così qualsiasi responsabilità in caso di output imprecisi o completamente errati. Nessuna garanzia, dunque, da parte della macchina: al contrario, tutta la responsabilità del lavoro svolto da quest’ultima rimane sull’avvocato, che spesso difetta degli strumenti e dell’expertise per comprendere a pieno i processi che portano a un determinato output, e non è dunque in grado di esaminarne agilmente l’accuratezza se non tramite un lavoro manuale parallelo di verifica. E tuttavia, sebbene i prodotti focalizzati sugli aspetti più sostanziali del lavoro dell’avvocato non siano ancora in grado di superare questo senso di diffidenza, in quanto di fatto non creano particolare efficienza, ne esistono altri, più specifici e mirati, che sono effettivamente in grado di velocizzare quelle attività meno tecniche della professione. Ciononostante, è bene sottolineare come l’adozione di qualsiasi strumento, a prescindere dalla sua capacità di velocizzare il lavoro del professionista, debba comunque fare i conti con la peculiare personalità degli avvocati, che spesso manca di adattabilità ed è riluttante al cambiamento e all’introduzione di nuovi procedimenti che modificano il modo in cui il professionista è abituato a svolgere determinate attività. Proprio a fronte di questa difficoltà di adattamento, è possibile affermare con relativa sicurezza che il processo di digitalizzazione degli studi, almeno in questa prima fase, non avverrà con la stessa velocità con cui le nuove tecnologie vengono sviluppate e lanciate sul mercato. Un tale ostacolo all’uso sistematico dell’intelligenza artificiale risulta particolarmente evidente alla luce delle differenze demografiche che caratterizzano gli studi legali, dove ben quattro generazioni diverse sono chiamate a interagire, se pur in maniera differente, con le nuove tecnologie. Il gap tra i due estremi, baby boomers e generazione Z, è considerevole: una generazione nasce con lo smartphone già in tasca, ed è per natura più incline ad accogliere le novità offerte dall’intelligenza artificiale; l’altra, nata e cresciuta senza internet, risulta spesso più restia ad aprirsi all’automazione. Questa differenza strutturale non può che complicare l’adozione delle tecnologie di intelligenza artificiale nella pratica forense, specie se si considera che gli organi decisionali degli studi legali risultano sovente composti da membri delle generazioni meno “tecnologiche”. Dunque, alla luce delle problematiche riscontrate, il percorso da seguire al fine di sfruttare a pieno le potenzialità dell’intelligenza artificiale nella professione forense si compone di tre step fondamentali: in primo luogo, è necessario condurre un’analisi attenta delle esigenze specifiche dello studio per individuare gli strumenti a disposizione dei professionisti in grado di soddisfarle in maniera efficace. Una volta individuati tali strumenti, è opportuno poi accertarsi che i professionisti che saranno chiamati a utilizzarli partecipino al processo decisionale che ne valuta la possibilità di integrazione all’interno dello studio legale. Infine, è essenziale affiancare al processo di integrazione un training aziendale mirato e su larga scala, finalizzato a fornire agli avvocati gli strumenti necessari per servirsi dell’intelligenza artificiale in maniera efficiente e fruttifera . © RIPRODUZIONE RISERVATA

Introduzione

Il fenomeno dell’Intelligenza Artificiale e la diffusione di app e strumenti di IA

L’Intelligenza Artificiale al Servizio della Creatività e delle Sfide Etiche

L’intelligenza artificiale (IA) è definita dall’Oxford English Dictionary come “la teoria e lo sviluppo di sistemi informatici in grado di svolgere compiti che normalmente richiedono l’intelligenza umana, come la percezione visiva, il riconoscimento vocale, i processi decisionali e la traduzione tra le lingue”.

Questa tecnologia avanzata sta rivoluzionando molti settori e quello legale non fa eccezione.

In un mondo sempre più interconnesso e digitale, la figura di Chat-GPT emerge come una rivoluzione nel campo dell’Intelligenza Artificiale (IA). Chat-GPT è diventato un fenomeno di vasta portata, stimolando la curiosità di milioni di utenti e aprendo nuove frontiere nell’interazione uomo-macchina. Questa piattaforma, capace di dialogare, creare contenuti e persino programmare, sta ridefinendo i limiti dell’IA.

Recentemente, un gruppo di ricercatori italiani ha messo in luce una problematica significativa: la facilità con cui Chat-GPT può generare dati scientifici falsi, sollevando questioni etiche e la necessità di un approccio critico verso le informazioni prodotte dall’IA.

Nonostante ciò, la Silicon Valley continua a cercare soluzioni per rendere l‘intelligenza artificiale più affidabile, ponendo l’accento su privacy, affidabilità e sostenibilità energetica.

Secondo recenti studi, l’intelligenza artificiale potrebbe contribuire in maniera significativa all’economia globale, con una previsione di crescita che potrebbe raggiungere i 15.7 trilioni di dollari entro il 2030. Ciò evidenzia non solo il potenziale economico dell’IA ma anche la sua capacità di influenzare positivamente diversi settori.

In questo contesto, Chat-GPT si configura come uno strumento versatile che può assistere nella creazione di contenuti SEO, nello sviluppo software e persino nell’arte della composizione musicale. L’utente ha la possibilità di interagire con un sistema intelligente per esplorare nuovi orizzonti creativi, come la formulazione di ricette personalizzate a partire dagli ingredienti disponibili.

“I Beatles e l’Intelligenza Artificiale: La Nascita di ‘Now and Then’, l’Ultimo Inedito”

“La leggendaria band di Liverpool torna a far parlare di sé con un singolo restaurato dall’IA, promettendo una nuova ondata di nostalgia e innovazione.”

La magia dei Beatles sembra non conoscere il concetto di ‘fine’. In una commistione tra passato e futuro, la tecnologia ha infatti aperto le porte a una sorpresa che nessun fan avrebbe osato sperare: un nuovo singolo inedito intitolato “Now and Then”. La canzone, scritta da John Lennon negli anni Settanta e custodita gelosamente da Paul McCartney, è venuto alla luce il 2 novembre, grazie a un intervento sofisticato di intelligenza artificiale.

Il rilancio di “Now and Then” è avvenuto in concomitanza con la produzione del documentario “The Beatles: Get Back” di Peter Jackson, il quale ha utilizzato l’IA per isolare tracce musicali. Questo ha permesso di “ripulire” la demo e di fondere la voce di Lennon con gli accompagnamenti registrati da George Harrison e Ringo Starr negli anni Novanta. Il risultato è un lavoro prodotto da McCartney e Giles Martin, figlio del celebre produttore dei Beatles, George Martin.

Paul McCartney ha espresso entusiasmo per questo progetto, sottolineando l’eccitazione di lavorare ancora una volta sulla musica dei Beatles e di poter offrire al pubblico qualcosa di completamente inedito.

L’evento segna un punto di incontro tra la nostalgia e le potenzialità dell’intelligenza artificiale nel settore musicale. Ma l’IA non si ferma qui: sta influenzando innumerevoli ambiti, come dimostrano le app creative che stanno conquistando i social media e i numerosi tool che stanno emergendo. Da Dall-E-2 a Character.AI, da Midjourney a Lensa AI, l’IA sta diventando uno strumento quotidiano imprescindibile per professionisti in ogni settore.

La Rivoluzione Silenziosa di ChatGPT: Come l’Intelligenza Artificiale Sta Cambiando il Nostro Modo di Comunicare

In un mondo sempre più interconnesso, l’intelligenza artificiale (IA) sta entrando silenziosamente nelle nostre vite, cambiando il modo in cui interagiamo con la tecnologia. Una delle innovazioni più sorprendenti in questo campo è ChatGPT, l’acronimo di Generative PreTrained Transformer, uno strumento di elaborazione del linguaggio naturale che segna un punto di svolta nell’interazione tra computer e linguaggio umano.

ChatGPT, sviluppato da OpenAI, si basa su potenti algoritmi di machine learning. Pre-allenato su vasti database, questo strumento è capace di apprendere continuamente, migliorando la sua capacità di comprendere e generare il linguaggio. Il risultato? Un’interazione così fluida e naturale che molti utenti dimenticano di “chiacchierare” con un bot e non con un essere umano.

Il programma beta di ChatGPT è liberamente accessibile e offre a milioni di utenti la possibilità di sperimentare le potenzialità del modello GPT-3. Questo terzo modello di Generative PreTraining è stato addestrato su un immenso corpus di dati che include testi online, articoli e siti web, rendendolo non solo accurato ma anche incredibilmente intuitivo.

Per coloro che desiderano spingersi oltre, ChatGPT 4 è disponibile attraverso l’abbonamento a ChatGpt Plus. Questa versione avanzata promette un’esperienza ancora più ricca e priva di limitazioni, aprendo nuove frontiere per l’utilizzo dell’IA.

Le applicazioni di ChatGPT sono ampie e variegate. Nel settore linguistico, ad esempio, può tradurre testi con una precisione che sfida quella umana. Nella scrittura creativa e SEO-oriented, aiuta a generare contenuti accattivanti e ottimizzati per i motori di ricerca. Nei social media, può creare post dinamici e migliorare le strategie di sponsorizzazione per brand e piccole e medie imprese, affinando il targeting e il retargeting.

Per gli sviluppatori, ChatGPT può generare codice, accelerando il processo di creazione del software. Nel settore educativo, facilita la realizzazione di materiali didattici personalizzati e report aziendali automatizzati. E non è tutto: può rendere i chatbot più “umani”, fornendo un supporto clienti tempestivo e accurato.

Tuttavia, nonostante le sue potenzialità quasi illimitate, ChatGPT si scontra con una realtà fatta anche di limiti tecnici. Il sito di OpenAI, a volte, fatica a gestire l’enorme afflusso di utenti desiderosi di sperimentare questa tecnologia rivoluzionaria.

In conclusione, ChatGPT rappresenta non solo un traguardo impressionante nel campo dell’IA ma anche un punto di partenza per nuove scoperte. Sta a noi comprendere e integrare queste tecnologie nelle nostre vite quotidiane, accettando la sfida di un futuro in cui le macchine parlano la nostra lingua.

Sam Altman: Tra Vicissitudini Manageriali e il Futuro dell’Intelligenza Artificiale

In una serie di eventi che potrebbero essere confusi con la trama di un romanzo cyberpunk, Sam Altman, figura emblematica nel mondo dell’Intelligenza Artificiale (IA), ha recentemente vissuto un tumulto professionale degno di nota. Il 30 novembre 2022, ad un anno da questo convegno, sotto la sua guida, OpenAI ha lanciato ChatGPT, segnando un momento storico nella corsa all’IA avanzata.

Tuttavia, meno di un anno dopo, il 17 novembre 2023, una svolta inaspettata ha visto Altman lasciare OpenAI, l’organizzazione no-profit da lui co-fondata nel 2015 insieme a figure di spicco come Elon Musk. La sua transizione a Microsoft ha suscitato molte speculazioni e dibattiti nell’ecosistema tecnologico.

Ma come in ogni buon racconto, c’è stato un ulteriore colpo di scena. Dopo solo una settimana di assenza, un nuovo Consiglio di Amministrazione ha richiamato Altman al timone di OpenAI come CEO. Questo ritorno suggerisce un riconoscimento del suo ruolo cruciale e visionario nell’avanzamento dell’IA.

La traiettoria di Altman è stata tutt’altro che ordinaria. Originario di Chicago e cresciuto a Saint Louis, si è trasferito in California per studiare scienze informatiche alla Stanford University. A soli diciannove anni, ha fondato Loopt, una piattaforma che permetteva la condivisione della posizione geografica.

Sotto la sua guida, OpenAI ha sviluppato ChatGPT, che alcuni ritengono possa ridefinire il futuro della ricerca online. Nonostante le affinità con i motori di ricerca tradizionali, ChatGPT non è destinato a sostituirli nel breve termine. I motori di ricerca si basano su algoritmi complessi per indicizzare e recuperare dati da una vastità quasi infinita di contenuti online, mentre ChatGPT risponde basandosi sulle informazioni ricevute durante il suo addestramento.

Ma l’intelligenza artificiale non nasce con OpenAI

L’AI, come la conosciamo oggi, ha celebrato il suo anniversario ufficiale nel 1956, ma le sue radici affondano molto più in profondità nella storia dell’innovazione umana.

La famosa conferenza estiva presso il Dartmouth College di Hannover, nel New Hampshire, è riconosciuta come il momento fondante dell’AI.

Fu qui che per la prima volta si coniugò il termine “Intelligenza Artificiale”, dando vita a una nuova disciplina scientifica. Tuttavia, gli anni ’40 del secolo scorso segnarono il vero inizio del viaggio dell’AI, influenzato dalla Seconda Guerra Mondiale e dall’avvento dei primi calcolatori.

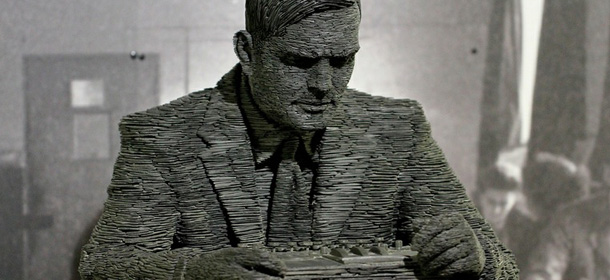

Alan Turing, uno scienziato inglese che è stato tra i pionieri dell’informatica moderna, è spesso citato come uno dei padri dell’AI. Il suo lavoro durante la guerra, in particolare nella crittografia e nella decifrazione del codice Enigma tedesco, non solo fu cruciale per la vittoria degli Alleati ma pose anche le basi per il futuro dell’AI.

Una statua di Alan Turing, creata in ardesia da Stephen Kettle nel 2007, si trova a Bletchley Park in Inghilterra come parte di una mostra in onore di Turing

Nel 1936, Turing pubblicò “On Computable Numbers, With An Application To The Entscheidungsproblem”, introducendo concetti come calcolabilità e computabilità e presentando la macchina di Turing, un modello teorico che sarebbe diventato la pietra angolare dell’informatica moderna.

Nel 1950, Turing propose il “Test di Turing” nel suo articolo “Computing Machinery and Intelligence”, un metodo per valutare la presenza di intelligenza “umana” in una macchina. Se un giudice non fosse stato in grado di distinguere tra le risposte di un uomo e quelle di una macchina, allora la macchina avrebbe potuto essere considerata “intelligente”.

Il convegno di Dartmouth del 1956, finanziato dalla Rockefeller Foundation e promosso da John McCarthy, insieme ad altre figure chiave come Marvin Minsky, Nathaniel Rochester e Claude Shannon, fu il punto di svolta che segnò l’inizio ufficiale dell’AI come campo di ricerca. La proposta originale suggeriva che ogni aspetto dell’apprendimento o qualsiasi altra caratteristica dell’intelligenza potesse essere descritto così precisamente da poter essere simulato da una macchina.

Da quei primi giorni, l’AI ha fatto passi da gigante. Dagli assistenti vocali ai sistemi di raccomandazione degli acquisti online, dalle diagnosi mediche assistite all’autoguida delle automobili, l’intelligenza artificiale è diventata una forza onnipresente che plasmerà il futuro dell’umanità in modi che gli stessi pionieri come Turing potevano solo immaginare.

Agosto 1956. Da sinistra verso destra: Oliver Selfridge, Nathaniel Rochester, Ray Solomonoff, Marvin Minsky, Trenchard More, John McCarthy, Claude Shannon.

Non solo ChatGPT: IA ed i suoi infiniti usi

1.1. DALL-E 2

Sempre OpenAI, ha realizzato DALL-E 2, aggiornato a gennaio 2022, è un potente algoritmo di Intelligenza Artificiale e machine learning che sfrutta GPT-3 per creare immagini a partire da semplici input di testo e generare modifiche ad esse.

Registrandosi, si hanno 50 crediti gratuiti, ma ogni qualvolta si compie un’attività sulle immagini si consuma un credito.

1. 3. Midjourney

Come DALL-E di OpenAI o Imagen di Google, Midjourney, lanciato a luglio del 2022 in beta e gratuito, si basa su un’Intelligenza Artificiale capace di creare immagini inedite a partire da descrizioni testuali. Basta un prompt (istruzioni di input, richieste sotto forma di domanda, frase o testo) per creare originali opere d’arte.

Un’opera creata con Midjourney ha vinto anche un concorso d’arte indetto dalla Colorado State Fair. Jason Allen si è aggiudicato il premio con il suo quadro Théâtre D’opéra Spatial generato dall’AI e subito sono scoppiate le polemiche.

Ecco un video tutorial rilasciato da Vincenzo Cosenza per capire come utilizzare Midjourney e scoprirne tutti i trucchi.

Altri tool simili sono: NightCafeAI che funziona attraverso crediti, DreamBooth AI, sviluppato dai ricercatori di Google Research e della Boston University nel 2022, che separa una foto dal suo contesto per creare una nuova ambientazione e Stable Diffusion AI, lanciato da Stability AI, è un generatore di arte di Intelligenza Artificiale open source che si basa sul linguaggio di programmazione Python che ha raccolto 101 milioni di dollari

1.4. Character.AI

Character.AI è una piattaforma di Intelligenza Artificiale che permette di conversare con le grandi personalità del passato e del presente, con personaggi inventati, del grande schermo, dei videogames e virtual YouTuber: da Socrate a Giulio Cesare, da Albert Einstein ad Alain Turing, dalla Regina Elisabetta a Elon Musk e a Steve Jobs, passando per Tony Stark del film Iron Man, Super Mario e Wonder Woman.

Mi sono imbucata come ospite sulla piattaforma, e in questa veste ci sono un numero di messaggi limitati, ma ho provato a chiedere a Wonder Woman il suo film preferito e a Napoleone Bonaparte il suo più grande successo.

1. 5. Lensa AI & Dawn AI

L’Intelligenza Artificiale in stile pop art ha avuto un successo dilagante con Lensa AI, l’app della società di editing foto e video Prisma Labs, che trasforma i selfie in avatar in stile cartoon che hanno invaso tutte le bacheche, i profili social. Lensa AI ha avuto un boom di download: oltre 1,5 milioni a novembre 2022 e 4 milioni solo nei primi giorni di dicembre.

Sulla stessa scia si pone anche l’app Dawn AI che attraverso un’IA avanzata genera avatar e disegni di vario tipo molto accurati e precisi, ma per alcune funzionalità avanzate si deve pagare settimanalmente.

1.6. Neuron Writer

Neuron Writer, è un tool per la SEO disponibile in 170 lingue che utilizza il linguaggio NLP GPT-3. Permette di scoprire le parole chiave che utilizza la concorrenza e attraverso un editor avanzato genera testi ottimizzati per i motori di ricerca.

1.7. AI Yepic Studio

AI Yepic Studio sia in versione free che a pagamento, è un tool che permette di generare video automaticamente personalizzandolo, scegliendo un proprio avatar, la voce da dargli, lo sfondo, le grafiche, impostando la lingua tra 75 possibili scelte ed oltre 100 dialetti, e decidendo il testo che la voce over leggerà.

1.8. Contents.com

Contents.com fornisce alle imprese una piattaforma che unisce la potenza di una IA generativa con la creatività e l’esperienza umana per ideare, creare e trasformare i propri contenuti: copy per adv, contenuti e testi per siti web e per e-commerce, contenuti multimediali in diverse lingue. Recentemente ha anche lanciato AI Art, per generare immagini da un comando si testo (Text-To-Image), migliore le foto (Image-To-Image) e perfezionare i lineamenti dei volti.

1.9. Tutti pazzi per l’IA: altri tool imperdibili

Calligrapher.AI, addestrata sul set di dati IAM On-Line Handwriting Database, è un tool assolutamente da provare: basta digitare il testo e comparirà sulla schermata una scrittura a mano e permette anche di variare leggermente la calligrafia.

Per pensare in grande ed essere eccellenti e brillanti col supporto dell’IA nel creare immagini, post, poesie, haiku, e-mail, storytelling potenziati e a forte impatto, si può scegliere tra diversi tool: GoCharlie.AI, Notion, Tome.

Per generare un nome perfetto e memorabile per il progetto o il proprio business si ci può sbizzarrire interrogando questi tool di Intelligenza Artificiale: namelix.com, businessnamemaker.com, biznamewiz.com, biznamewiz.com, namesnack.com.

Ed ancora Descript trascrive il parlato e permette di fare il montaggio in modo molto semplice, Clipchamp parte da un testo per generare l’audio, scegliendo tra oltre 170 voci in 70 lingue diverse, optando per tre diverse velocità per la voce fuori campo. E sempre per l’audio, l’IA di Overdub ti semplifica la vita.

Inoltre in campo musicale, Open AI Jukebox che si basa su una rete neurale addestrata su un ampio set di registrazioni musicali, canzoni esistenti, è un fantastico alleato per generare brani inediti.

Conclusioni

L’Intelligenza Artificiale apre infiniti interrogativi sui risvolti etici, sociali e legali, ma questo viaggio insieme dimostra che si è diffusa su larga scala in ogni ambito, dall’arte al digitale, dall’intrattenimento al lavoro fino al marketing e alla comunicazione dei brand. Non a caso Mulino Bianco ha inaugurato il 2023 con un post con le immagini dei pancake generate con l’AI Midjourney.

Quindi quest’anno ed il futuro accelereranno nella direzione dell’IA, dal copy al visual, trasformando la creatività ed il marketing aziendale, ma sarà indispensabile anche in ambito della comunicazione social e digital.

Avvocati ed intelligenza artificiale

L’avvento dell’intelligenza artificiale nel campo legale ha suscitato controversie, ma anche offerto nuove opportunità e presentato nuove sfide etiche.

Attualmente, la categoria ha affrontato la novità con un approccio freddo, a volte preoccupata dalle possibili implicazioni che lo sviluppo dell’intelligenza artificiale potrebbe avere sulle prospettive future.

La Commissione Nuove Tecnologie della Fédération des Barreaux d’Europe ha delineato sette buone pratiche per l’uso responsabile dell’Intelligenza Artificiale nel settore legale, considerando alcuni esempi controversi come “Do Not Pay” e i recenti problemi causati dall’uso incauto di ChatGPT.

Che cosa è lA IA GENERATIVA?

L’intelligenza artificiale generativa (GenAI) si riferisce a sistemi di intelligenza artificiale in grado di generare testo, immagini o altri media in risposta a richieste.

Questi sistemi, noti come LLM (Large Language Models), sono in grado di produrre output che assomiglia molto al linguaggio umano.

Gli utenti interagiscono con la GenAI attraverso specifici strumenti che si basano su questi modelli. Ad esempio, ChatGPT di OpenAI è un sistema di GenAI ottimizzato per il dialogo, basato su GPT-3.5/GPT-4. Allo stesso modo, Bard è un chatbot di GenAI sviluppato da Google, che si concentra sulla conversazione e inizialmente utilizza LaMDA (Language Models for Dialog Applications).

Gli attuali player: che cosa è Do Not Pay?

Tutto ha avuto inizio con una pila di biglietti del parcheggio dell’Università di Stanford. Il Ceo e fondatore di DoNotPay, Joshua Browder, ha spiegato che non poteva permettersi il costo delle multe, così ha cominciato a diventare un esperto in scappatoie per evitare di pagarle.

DoNotPay, una start-up specializzata in intelligenza artificiale, ha sviluppato un progetto che funzionerà su smartphone e che sarà in grado di ascoltare le argomentazioni in tribunale in tempo reale. L’IA riferirà poi all’imputato come rispondere, ripetendo le parole dettate dall’IA. Il caso pilota riguarda una multa per eccesso di velocità e l’IA difenderà il suo cliente. In caso di sconfitta, Joshua Browder ha spiegato che coprirà eventuali spese.

Browder sta puntando alla Corte Suprema e ha scritto su Twitter che “DoNotPay” pagherà 1.000.000 di dollari a qualsiasi avvocato o persona che ha un caso imminente davanti alla Corte Suprema degli Stati Uniti per indossare gli AirPods e lasciare che il loro avvocato robot discuta il caso ripetendo esattamente ciò che viene detto.

L’intelligenza artificiale interagisce con il cliente per comprendere il problema legale, quindi crea una lettera personalizzata che può essere inviata all’istituzione competente o caricata su un sito web. Durante un processo, l’IA funge da avvocato, fornendo indicazioni all’imputato tramite un auricolare con connettività Bluetooth, come ad esempio un AirPod o un apparecchio acustico.

Browder ha spiegato che è stato necessario molto tempo per addestrare l’assistente AI del servizio, al fine di fornire tutte le informazioni necessarie per consentire all’IA di accedere alle fonti di diritto. Il suo obiettivo finale è quello di rendere disponibile un’applicazione in grado di sostituire gli avvocati nelle cause più semplici, al fine di garantire un risparmio per gli imputati.

“Ci sono ancora molti professionisti validi in grado di difendere le proprie cause dinanzi alla Corte europea dei diritti dell’uomo, tuttavia molti avvocati richiedono somme esorbitanti per compiere attività banali come copiare e incollare documenti. Ritengo che saranno presto sostituiti, e dovrebbero esserlo.”

Robo-Lawyer

Un altro esempio notevole è quello di Do Not Pay, una start-up americana che ha lanciato il suo servizio primario come “Robo-Lawyer“.

L’American Bar Association (l’associazione degli avvocati :-)) il software – o “robo-avvocato” – non possederebbe le competenze giuridiche richieste, né l’autorizzazione per esercitare la professione legale.

Cosa è successo a New York?

Di recente, due avvocati di New York sono stati multati per aver presentato un documento legale contenente citazioni di casi falsi. Questi casi falsi sono stati generati da ChatGPT, un chatbot noto per il fenomeno dell'”allucinazione”.

L’allucinazione si verifica quando i chatbot forniscono risposte che sembrano convincenti, ma che in realtà sono completamente inventate o errate. In questo caso, gli avvocati hanno utilizzato le indicazioni e le citazioni giurisprudenziali errate fornite da ChatGPT durante una controversia legale riguardante il risarcimento dei danni causati a un passeggero da un carrello portavivande fuori controllo durante un volo per New York, operato da una compagnia aerea colombiana.

Tale situazione di disagio, che aveva portato all’ordine del giudice, impartito all’avv. Steven A. Schwartz, di porgere le proprie scuse alla corte e ai magistrati citati nelle sentenze inventate da ChatGPT e riprodotte in atti nella vicenda sopra ricordata, era stata seguita dall’emissione di numerosi ordini da parte di alcuni giudici, con l’intento di limitare il ricorso degli avvocati all’impiego degli algoritmi di IA.

Fra questi ordini, il 6 giugno 2023, il giudice Michael M. Baylson dell’Easter District della Pennsylvania ha stabilito che gli avvocati che utilizzano l’intelligenza artificiale (IA) devono dichiarare chiaramente quale piattaforma di IA hanno impiegato per la preparazione dei documenti processuali.

Inoltre, devono certificare che tutte le citazioni di fonti normative e quanto riportato negli scritti sono stati verificati come accurati. Questa misura è stata adottata al fine di garantire la trasparenza e l’accuratezza delle informazioni presentate durante il processo legale.

L’ABA (American Bar Association) ha istituito una Task Force con l’obiettivo di affrontare e risolvere i problemi derivanti dall’uso improprio del machine learning, che si sono verificati di recente negli Stati Uniti.

La reazione del Texas

I legali dovranno attestare che “nessuna parte della causa è stata redatta dall’intelligenza artificiale generativa” o, se lo è, che è stata controllata “da un essere umano”.

Un giudice federale del Texas ha imposto una scelta obbligatoria dopo i casi di utilizzo dell’Intelligenza Artificiale in tribunale.

Il giudice federale del Texas, Brantley Starr, ha adottato misure per garantire la regolamentazione dell’uso dell’intelligenza artificiale generativa in aula. Ogni avvocato che compare nella sua corte deve attestare che nessuna parte della causa è stata redatta dall’intelligenza artificiale generativa o, se lo è, che è stata controllata da un essere umano. Questo provvedimento è stato adottato per garantire l’equità e l’imparzialità dei processi giudiziari.

Tutti gli avvocati che compaiono davanti alla Corte devono presentare un certificato appositamente redatto, in cui dichiarano che ogni contenuto prodotto dall’IA è stato attentamente controllato da un essere umano utilizzando i database legali tradizionali o fonti stampa.

Le Nuove Direttive della United States Court of International Trade

Un recente ordine della corte americana pone nuovi standard per l’utilizzo dell’intelligenza artificiale nel settore legale, evidenziando le sfide della riservatezza dei dati.

L’8 agosto 2023, la United States Court of International Trade ha emesso un ordine che potrebbe riscrivere le regole del gioco per l’uso dell’intelligenza artificiale (IA) nel campo legale. In un mondo sempre più interconnesso, dove la tecnologia si intreccia indissolubilmente con la vita quotidiana, la corte ha preso una posizione decisa sul delicato equilibrio tra innovazione e privacy.

L’Ordine del Giudice Stephen A. Vaden

Il giudice Stephen A. Vaden della United States Court of International Trade ha stabilito che qualsiasi documento presentato alla corte, che sia stato redatto con l’assistenza dell’IA, deve essere accompagnato da una dichiarazione specifica.

Questa deve indicare il programma utilizzato e le parti del testo generate dall’IA.

La direttiva mira a garantire che l’utilizzo di tali tecnologie non comprometta la confidenzialità delle informazioni sensibili.

Un Passo Verso il Futuro o un Ostacolo all’Innovazione?

L’ordine della corte rappresenta un punto di svolta nel modo in cui l’intelligenza artificiale viene vista nel contesto legale. Da una parte, stabilisce un precedente per la protezione dei dati in un’era digitale; dall’altra, solleva interrogativi sulla fattibilità a lungo termine di tali restrizioni in un ambiente professionale in rapida evoluzione.

In conclusione, mentre la United States Court of International Trade si sforza di navigare tra le acque inesplorate dell’IA e della privacy, il suo recente ordine può servire sia come faro per una maggiore responsabilità sia come campanello d’allarme per i rischi che l’innovazione sfrenata può comportare per i diritti individuali. La strada da percorrere è ancora lunga e ricca di sfide, ma una cosa è certa: il dialogo tra tecnologia e legge è più vivo che mai.

Siamo sempre più vicini ad avere sistemi di intelligenza artificiale in grado di prevedere le decisioni dei giudici. Mentre alcuni considerano questa possibilità fantascienza, altri credono che la tecnologia sia ormai matura per farlo.

La tecnologia dell’Intelligenza Artificiale sta rivoluzionando il settore legale negli Stati Uniti e le aziende come Lex Machina di LexisNexis stanno già applicando algoritmi predittivi per stimare gli esiti delle cause e il comportamento dei giudici federali in materia di proprietà intellettuale e antitrust con una precisione del 79%.

Anche le società di revisione legale tra le Big Four, come Deloitte e PwC, stanno investendo in soluzioni di predictive analytics per il mercato legale.

In Gran Bretagna, a Cambridge, un team di ricercatori ha sviluppato un innovativo sistema di intelligenza artificiale chiamato AI Lawyer. Questo sistema utilizza il machine learning per analizzare i dati legali e prevedere le decisioni della Corte Europea dei Diritti dell’Uomo con una precisione del 79%. Grazie all’identificazione di modelli nei dati, AI Lawyer offre una prospettiva predittiva nel campo giuridico.

E in Italia?

Uno studio del 2021 condotto da Giuseppe Contissa, ricercatore presso l’Istituto di teoria e tecniche dell’informazione giuridica (ITTIG) del CNR di Firenze, ha analizzato 2000 sentenze della Corte di Cassazione tra il 2020 e il 2021 per prevedere l’esito delle decisioni sulla base dei dati contenuti nel ricorso introduttivo.

I risultati mostrano che l’AI è stata in grado di prevedere correttamente l’esito nel 70% dei casi esaminati.

Tuttavia, secondo alcuni esperti, il diritto non è una scienza esatta e richiede capacità di interpretazione che le macchine attualmente non possiedono.

Nonostante ciò, in Italia ci sono diverse soluzioni di AI legale, come Iurix e LexDo.it, che combinano reti neurali e machine learning per effettuare ricerche legali semantiche e fornire un primo parere sull’esito potenziale delle controversie.

Secondo una recente indagine, il 42% degli studi legali italiani ha già adottato o prevede di adottare soluzioni di intelligenza artificiale entro 3 anni.

Le cinque tecnologie IA indispensabili per i professionisti legali

Titolo: Tecnologie IA indispensabili per i professionisti legali

Negli ultimi anni, il settore legale ha iniziato ad abbracciare le tecnologie basate sull’intelligenza artificiale (IA) per affrontare le sfide e migliorare l’efficienza delle operazioni legali. Ci sono diverse tecnologie IA che si sono dimostrate indispensabili per i professionisti legali. Vediamo quali sono:

- Traduzione automatica: Con l’aumento dei clienti internazionali e la necessità di comprendere e comunicare in diverse lingue, la traduzione automatica si è rivelata un’importante risorsa. Gli studi legali possono utilizzare la traduzione automatica per tradurre documenti legali, comunicare con team e clienti internazionali e condurre ricerche sulle leggi e i regolamenti stranieri. Tuttavia, è importante sottolineare che la traduzione automatica non sostituisce completamente i traduttori umani, specialmente per documenti ufficiali che richiedono traduzioni certificate o asseverate.

- Sistemi di gestione della conoscenza basati sull’IA: I sistemi di gestione della conoscenza alimentati dall’IA consentono ai professionisti legali di accedere rapidamente a informazioni cruciali. Queste tecnologie consentono di effettuare ricerche rapide su grandi quantità di dati, identificando elementi ricorrenti nei documenti legali e rimanendo aggiornati sulle ultime novità delle leggi e dei regolamenti. Inoltre, automatizzano processi ripetitivi come la categorizzazione dei documenti, aumentando la produttività degli avvocati.

- Analisi e gestione dei contratti con l’IA: L’analisi e la gestione dei contratti sono aree in cui l’IA ha dimostrato un grande potenziale. Gli strumenti basati sull’IA automatizzano compiti come la revisione dei documenti e la gestione delle scadenze per gli accordi firmati. Consentono agli avvocati di rivedere rapidamente i contratti, identificando potenziali problemi e riducendo i rischi derivanti dalla mancata conformità alle leggi o ai regolamenti. Inoltre, offrono informazioni sui casi passati, migliorando il servizio ai clienti e mantenendo la competitività sul mercato.

- IA generativa per la creazione di documenti: L’IA generativa sta rivoluzionando la creazione di documenti nel settore legale. Questa tecnologia utilizza algoritmi di intelligenza artificiale per creare documenti basati su modelli e set di dati strutturati, migliorando l’efficienza del processo di creazione. Tuttavia, è importante sottolineare che l’IA generativa non sostituisce il lavoro degli avvocati, ma li supporta nel processo di creazione dei documenti.

- Acquisire clienti con i chatbot: come l’intelligenza artificiale sta cambiando il modo di fare business ?

Legal resarch

Negli ultimi anni si sono diffusi sempre più a livello internazionale tool di legal research basati sull’AI, che permettono di effettuare ricerche giuridiche in modo rapido e accurato. La maggior parte di essi è in lingua inglese e riguarda dottrina, giurisprudenza e normativa americana.

AI come valido collaboratore nella professione forense

In ogni attività compiuta con l’ausilio della AI la premessa resta di non farsi mai sostituire dall’Intelligenza Artificiale e non affidarsi ciecamente ad essa, bensì renderla un valido alleato nel lavoro. La conoscenza del suo funzionamento, la capacità critica di valutare gli output e, più in generale, una adeguata cultura dell’uso corretto della tecnologia sono gli elementi indispensabili per vivere in modo responsabile questi strumenti dalle grandi potenzialità.

Quali sono, dunque, le potenzialità insite nell’uso dell’Intelligenza Artificiale applicata alla ricerca normativa, giurisprudenziale e dottrinale?

Come abbiamo specificato sopra, lo strumento ha grandi potenzialità, ma la base dei dati da cui parte e le capacità di utilizzo dell’utente fanno poi la differenza nell’affidabilità e completezza dei risultati. Vediamo, in attesa che anche in Italia si diffondano tool specializzati nella Legal Research, alcuni consigli pratici su come sfruttare al meglio questi strumenti nella quotidianità della professione forense, a cominciare da ciò che offre il mercato in questo momento, in primis Chat GPT.

L’obiettivo è capire come l’AI può migliorare il lavoro dell’avvocato, non sostituirlo, e come integrarla nel proprio flusso di lavoro per incrementare produttività ed efficienza.

I vantaggi dell’Intelligenza Artificiale per la ricerca giuridica

Vediamo, dunque, quali sono i principali vantaggi che l’AI può portare nella ricerca giuridica:

- Velocità: i motori di ricerca basati sull’AI analizzano in pochi secondi milioni di documenti e identificano i risultati più rilevanti. Si risparmia così molto tempo rispetto alle tradizionali ricerche manuali.

- Precisione: grazie ad algoritmi di elaborazione del linguaggio naturale, l’AI comprende il significato della query di ricerca ed estrae i documenti davvero attinenti, escludendo falsi positivi.

- Aggiornamento: se i database di giurisprudenza e normativa da cui attinge l’AI vengono costantemente aggiornati, i risultati possono essere estremamente accurati e aggiornati.

- Tracciabilità: i percorsi di ricerca possono essere salvati e condivisi, assicurando la replicabilità del lavoro svolto.

- Analytics: l’AI consente di ottenere analisi e statistiche utili per comprendere trend giuridici.

Alcuni esempi

Ross

Nel panorama legale contemporaneo, l’innovazione più disruptive non arriva dalla legge stessa, ma dalla tecnologia che la interpreta. Tra le fila degli studi legali, una nuova figura sta emergendo: l’avvocato robot. Un esempio lampante è Ross, il primo avvocato artificiale al mondo, sviluppato dalla startup canadese Ross Intelligence in collaborazione con la piattaforma Watson di IBM [3].

Ross non è un androide né una figura fantascientifica, ma un software basato sull’intelligenza artificiale di IBM Watson, che ha il compito di semplificare e velocizzare il lavoro degli avvocati [2]. È stato “assunto” da diversi studi legali, incluso uno dei giganti americani, Baker & Hostetler, dove si occupa principalmente di questioni legate alla bancarotta [4].

La rivoluzione di Ross risiede nella sua capacità di comprendere il linguaggio naturale. Gli avvocati possono porre domande in inglese e Ross, dopo aver scansionato in pochi istanti l’intero corpus legale, restituisce risposte complete di suggestioni e aggiornamenti su nuovi verdetti pertinenti ai casi trattati [1]. Questo non solo accelera il processo di ricerca giuridica, ma permette anche di abbattere i tempi che tradizionalmente richiederebbero giorni e la collaborazione di più avvocati.

L’intelligenza artificiale di Ross è progettata per apprendere dall’esperienza, migliorando continuamente le sue capacità cognitive e operative. È in grado di intrattenere conversazioni con umani, rispondendo a domande legali con argomentazioni supportate da citazioni e letture pertinenti, oltre a fornire fonti secondarie per una strategia legale più informata.

Nonostante l’efficienza di Ross, gli avvocati possono stare tranquilli: il ruolo umano nella professione forense non è messo in discussione. Piuttosto, Ross si pone come uno strumento per affinare e completare il lavoro umano, non per sostituirlo. La sua presenza negli studi legali è un passo avanti nel lungo cammino verso un futuro dove la tecnologia e la legalità si intrecciano sempre più strettamente, promettendo scenari ancora più interessanti nel campo della giurisprudenza digitale [2].

In conclusione, Ross è la punta dell’iceberg in un mare di cambiamenti guidati dall’intelligenza artificiale nel settore legale. Mentre alcuni potrebbero temere l’arrivo di questi “robot avvocati”, è chiaro che il loro obiettivo non è sostituire l’intelligenza umana ma piuttosto amplificarne le capacità, offrendo strumenti che permettono ai professionisti del diritto di navigare l’oceano legale con una bussola sempre più precisa e affidabile.

Kyra

Nel mondo frenetico delle fusioni e acquisizioni (M&A), la due diligence è un processo cruciale ma laborioso, che può determinare il successo o il fallimento di un accordo. Noah Waisberg, ex avvocato di M&A, ha identificato questa sfida e ha fondato Kira Systems nel 2011, con l’obiettivo di trasformare radicalmente il processo di due diligence attraverso l’intelligenza artificiale

Il software di Kira Systems si distingue per la sua capacità di eseguire analisi contrattuali con un livello di precisione e velocità senza precedenti. Utilizzando algoritmi di apprendimento automatico, Kira è in grado di scandagliare documenti legali, evidenziare e estrarre informazioni cruciali, velocizzando il processo fino al 40% la prima volta che viene utilizzato, e fino al 90% nelle volte successive [3].

Questo strumento AI non solo promette di ridurre il carico di lavoro degli avvocati ma anche di aumentare l’accuratezza dell’analisi legale, riducendo così il rischio di errori costosi durante le operazioni di M&A. La fiducia nel potenziale di Kira Systems è evidenziata dai 65 milioni di dollari raccolti in un round di finanziamento di serie A nel settembre 2018.

La promessa di Kira Systems va oltre la semplice efficienza. Kyra, il software per la due diligence dei contratti, rappresenta una pietra miliare nell’evoluzione digitale degli studi legali, permettendo loro di analizzare grandi volumi di contratti, individuare le clausole chiave e le parti più rilevanti con una precisione che prima era impensabile.

Mentre il software continua a evolversi, così fa il ruolo degli avvocati nell’era digitale. Con strumenti come Kira, gli studi legali possono ora concentrarsi su compiti più strategici e consulenziali, lasciando che l’intelligenza artificiale si occupi dell’analisi dettagliata e della gestione dei dati.

Kira Systems non solo sta ridefinendo l’efficienza nel campo legale ma sta anche dimostrando come l’intelligenza artificiale possa essere una forza abilitante, piuttosto che sostitutiva, nel mondo professionale. Con la sua crescita continua e l’adozione da parte di studi legali in tutto il mondo, Kira rappresenta un’avanguardia nella tecnologia governativa e nella trasformazione digitale del settore legale [1].

In conclusione, Kira Systems sta plasmando il futuro della due diligence legale con un impatto che va ben oltre la semplice automazione: sta riscrivendo le regole del gioco, permettendo ai professionisti legali di navigare attraverso complessità contrattuali con una nuova lente, quella dell’intelligenza artificiale.

Coin

JP Morgan, un colosso nel settore bancario, ha adottato un approccio pionieristico all’AI con lo sviluppo di Coin (Contract Intelligence). Questo bot machine learning è un esempio eclatante di come l’AI possa ottimizzare operazioni che tradizionalmente richiederebbero un enorme dispendio di tempo umano. Con l’abilità di svolgere 360 mila ore di lavoro ripetitivo in un anno, mansioni precedentemente affidate agli avvocati ora vengono eseguite in una frazione del tempo. Coin non è solo un risparmio di tempo ma anche un incremento nella precisione dei dati analizzati, riducendo drasticamente la possibilità di errore umano.

Luminance: L’AI Che Illumina la Gestione Documentale

Dall’altra parte, abbiamo Luminance, che si è distinto come una delle più promettenti innovazioni nel campo dell’AI applicata al legale. Creato da matematici di Cambridge, questo software è in grado di archiviare e classificare centinaia di documenti legali con una rapidità e precisione che sfidano ogni metodo tradizionale. Luminance utilizza algoritmi sofisticati per analizzare la struttura e il linguaggio dei documenti, identificando modelli e anomalie che potrebbero sfuggire persino agli occhi più esperti.

GiuriMatrix

Il panorama legale italiano si arricchisce di un nuovo e rivoluzionario strumento: GiuriMatrix, il primo assistente legale basato sull’intelligenza artificiale, progettato per fornire supporto a professionisti del diritto, avvocati e non solo.

GiuriMatrix emerge come una soluzione all’avanguardia, con l’ambizione di trasformare il modo in cui gli operatori del settore legale interagiscono con la legislazione e la giurisprudenza. Sviluppato da un team di esperti che comprende l’avvocato Luigi Viola, specializzato in giustizia predittiva e applicazioni AI nel diritto, insieme agli ingegneri Francesco Cozza e Pierluigi Casale e il professore Michele Filippelli, GiuriMatrix promette di elevare l’efficienza e la precisione nel mondo legale.

Il cuore pulsante di GiuriMatrix è una tecnologia avanzata che consente di risparmiare tempo prezioso e incrementare la produttività. Questo strumento è capace di interpretare interrogativi posti in linguaggio naturale e di fornire risposte precise, citando sempre le fonti legislative pertinenti. Il software, totalmente gratuito, si distingue per la sua capacità di rispondere a quesiti di diritto civile con un approccio innovativo.

Durante una dimostrazione pratica, GiuriMatrix ha brillantemente risposto alla domanda “È ammissibile la donazione di cosa altrui?” citando l’articolo 769 del Codice Civile e confermando che tale atto è nullo e privo di effetti giuridici. Questa performance evidenzia non solo l’abilità del sistema nel fornire informazioni legali accurate, ma anche nel rimanere trasparente e verificabile.

Il software si configura come un primo passo verso un futuro in cui l’intelligenza artificiale potrà affiancare i professionisti del diritto nella gestione quotidiana delle loro attività, senza però mai prescindere dall’insostituibile giudizio umano.

L’approccio di GiuriMatrix è pragmatico: utilizza dottrina e giurisprudenza esclusivamente per facilitare l’individuazione delle norme codicistiche, basandosi sulla convinzione che le risposte alle questioni legali debbano derivare innanzitutto dalla legge, la quale ha un valore vincolante universale.

Con GiuriMatrix, l’Italia si posiziona all’avanguardia nel settore dell’intelligenza artificiale applicata al diritto, aprendo la strada a nuove possibilità per i professionisti e contribuendo a rendere la consulenza legale più accessibile. Nel mondo in rapida evoluzione in cui viviamo, strumenti come GiuriMatrix rappresentano non solo un passo avanti tecnologico ma anche un potenziale miglioramento nella qualità e nell’accessibilità della giustizia.

La posizione del CNF

L’IA nel Settore Legale: Un Cambiamento Inevitabile

Il Consiglio Nazionale Forense (CNF) ha riconosciuto l’importanza dell’IA nel settore legale, pubblicando le “Linee guida sull’intelligenza artificiale e il diritto“. Questo documento fornisce una base per l’utilizzo dell’IA nel settore legale, garantendo al contempo la tutela dei diritti e delle libertà fondamentali delle persone.

Ad esempio, l’IA può aiutare nella qualificazione di casi specifici, nella ricerca di precedenti giurisprudenziali e dottrinali e nella prefigurazione degli scenari processuali. Anche se le linee guida non menzionano esplicitamente la predizione, è evidente che l’uso degli strumenti di Intelligenza Artificiale è sempre più diffuso e la professione legale sta cercando di adattarsi a questa realtà.

Il Futuro dell’Avvocatura: Un Portale Basato sull’IA

Il CNF si sta preparando ad affrontare questo cambiamento e intende realizzare un Portale dell’Avvocatura Italiana, basato sull’intelligenza artificiale. Questo portale sarà messo gratuitamente a disposizione di tutti: avvocati, cittadini e magistrati. Sarà un portale certificato, con la certezza che i dati che vengono immessi siano completi e verificati[3].

Principi Fondamentali dell’IA nel Settore Legale

Le linee guida del CNF si basano su sei principi fondamentali:

- Responsabilità: i professionisti che utilizzano l’intelligenza artificiale devono essere responsabili delle conseguenze delle loro azioni.

- Trasparenza: i professionisti devono essere trasparenti riguardo all’utilizzo dell’intelligenza artificiale e dei dati che essa utilizza.

- Imparzialità: l’intelligenza artificiale deve essere utilizzata in modo imparziale, senza discriminare sulla base di razza, genere, orientamento sessuale, religione o altri fattori.

- Privacy: i professionisti devono proteggere la privacy dei dati degli utenti e garantire che l’uso dell’intelligenza artificiale sia conforme alle leggi sulla privacy.

- Sicurezza: i professionisti devono garantire la sicurezza dei sistemi di intelligenza artificiale e proteggere gli utenti da eventuali minacce.

- Controllo umano: l’utilizzo dell’intelligenza artificiale deve essere sempre sotto il controllo umano e non deve sostituire completamente le decisioni umane[4].

L’Essenziale Regolamentazione dell’Intelligenza Artificiale nel Diritto Internazionale

Iniziative Internazionali per un IA Responsabile

Recentemente, l’Organizzazione per la Cooperazione e lo Sviluppo Economico (OCSE) ha adottato delle Linee Guida sull’Intelligenza Artificiale.

Queste raccomandazioni sono un faro per gli Stati membri, delineando principi per un utilizzo dell’IA che sia innovativo e al tempo stesso responsabile. I principi chiave includono la trasparenza, la sicurezza e la privacy, oltre all’equità e all’accountability.

Parallelamente, l’Organizzazione delle Nazioni Unite (ONU) ha istituito un gruppo di lavoro dedicato all’IA.

L’obiettivo? Promuovere la cooperazione internazionale e affrontare le complesse questioni etiche e giuridiche che emergono dall’uso dell’IA. Questo gruppo di lavoro è un segnale chiaro del riconoscimento globale dell’importanza di un quadro normativo per l’IA.

Giustizia Equa ed Efficace nell’Era dell’IA

Nel contesto giuridico, l’utilizzo dell’IA solleva questioni fondamentali riguardanti l’imparzialità e l’equità.

È imperativo che i sistemi di IA impiegati nella giustizia e nell’applicazione della legge siano non solo efficaci ma anche giusti. Ciò significa adottare regolamenti che promuovano la trasparenza nei modelli di IA e che istituiscano meccanismi di accountability.

Un aspetto cruciale è il rispetto dei diritti dei cittadini. In un mondo sempre più digitalizzato, la protezione della privacy e dei dati personali diventa un pilastro centrale di qualsiasi regolamentazione sull’IA.

Le autorità devono assicurarsi che i dati raccolti dalle IA siano utilizzati in maniera etica e con il consenso degli interessati.

Verso un Futuro Regolamentato

L’integrazione dell’IA nei sistemi giuridici non è più una questione di ‘se’, ma di ‘come’. Le iniziative dell’OCSE e dell’ONU sono solo l’inizio di un dialogo globale che deve tradursi in leggi concrete, pratiche equitative e standard etici universali.

Le linee guida della Commissione Nuove Tecnologie della Fédération des Barreaux d’Europe

Anche in ragione di quanto sopra, la Federazione europea degli avvocati (FBE) ha pubblicato le Linee guida della commissione nuove tecnologie (disponibili qui) per formare gli avvocati all’uso responsabile e deontologicamente corretto degli strumenti di Intelligenza Artificiale nella professione legale. Questo documento fornisce un quadro completo delle migliori pratiche per l’utilizzo dell’Intelligenza Artificiale nel settore legale.

Il rapporto è intitolato “Gli Avvocati Europei Nell’era Di Chat Gpt – Linee Guida Per Massimizzare Le Opportunità Offerte Dai Modelli Linguistici Di Grandi Dimensioni E Dall’Intelligenza Artificiale Generativa”.

Le linee guida sono state create per assicurare che la tecnologia venga compresa in modo adeguato, che se ne conoscano le limitazioni, che si rimanga aggiornati sulle normative, che si integri con le competenze umane, che si rispetti il segreto professionale, che si proteggano i dati personali e che si comunichi in modo trasparente con i clienti.

Il rapporto analizza il futuro del settore legale, prevedendo l’emergere di sistemi di intelligenza artificiale generativa specializzati progettati appositamente per semplificare i compiti dei professionisti.

Tuttavia, la Commissione mette in guardia dal rischio di utilizzare in modo inappropriato gli strumenti di GenAI per compiti che richiedono la competenza legale e il rapporto diretto tra cliente e avvocato, nonostante i notevoli vantaggi offerti dall’utilizzo dell’IA generativa.

La Commissione Nuove Tecnologie della FBE

1- ha suggerito l’implementazione di buone prassi per l’utilizzo di modelli linguistici di grandi dimensioni e strumenti di intelligenza artificiale generativa nel corso dell’esercizio professionale legale. Questo aiuterà a migliorare l’efficienza e la precisione del lavoro svolto dagli operatori del diritto, aumentando così la qualità dei servizi offerti ai clienti.

2 – ha individuato sette pratiche fondamentali per garantire l’osservanza di elevati standard etici, la tutela della riservatezza dei clienti e la promozione di un uso consapevole e responsabile dell’intelligenza artificiale generativa e dei modelli linguistici di grandi dimensioni nel contesto legale.

Le sette pratiche fondamentali

1) Comprendere la tecnologia della IA generativa

Assicurarsi di acquisire una conoscenza approfondita della tecnologia di intelligenza artificiale generativa che si utilizza nella professione. Ciò permetterà di sfruttare al meglio le sue capacità e funzionalità, nonché di comprendere le potenziali implicazioni legali.

Dedicare del tempo a studiare le basi teoriche e pratiche dell’IA generativa, e cercare di tenersi costantemente aggiornato sulle ultime novità e sviluppi del settore.

La conoscenza dell’utilizzo appropriato e responsabile della tecnologia aiuterà a prendere decisioni consapevoli sul modo migliore di sfruttarla efficacemente nel lavoro. In particolare, come avvocato, è importante comprendere il funzionamento della tecnologia di intelligenza artificiale generativa e le insidie già note legate all’apprendimento automatico, come il bias e la mancanza di interpretazione e i rischi specifici della Linguistica del Linguaggio Naturale (LLM) e della GenAI, come le allucinazioni.

È fondamentale conoscere il principio di base degli LLM, che è quello di prevedere il token successivo, ovvero la parola successiva in una sequenza di parole. Questo può portare a risposte generate dalla GenAI.

2) Riconoscere le limitazioni e il contesto

E’ importante tenere presente che questa tecnologia ha anche dei limiti intrinseci. Ad esempio, i contenuti generati dall’intelligenza artificiale potrebbero non essere sempre del tutto accurati, completi o aggiornati.

Inoltre, i grandi modelli linguistici presentano rischi di allucinazioni e pregiudizi. Infine, è importante ricordare che i sistemi di GenAI di supporto alla conversazione, sebbene utili in alcune applicazioni, potrebbero non essere adatti per altre applicazioni, come quelle legali.

Pertanto, è sempre consigliabile verificare l’output generato dal sistema.

È consigliabile evitare di utilizzare sistemi generici di intelligenza artificiale generativa conversazionale, in quanto potrebbero non essere adatti per applicazioni che richiedono una rigida conformità alle normative legali.

3) Rispettare le regole esistenti sulla IA

È importante che gli avvocati europei siano a conoscenza delle norme che disciplinano l’uso dell’intelligenza artificiale, in modo da garantire l’aderenza agli standard deontologici e legali.

Al momento, l’Unione Europea sta approvando il Regolamento sull’intelligenza artificiale, pertanto è fondamentale rimanere aggiornati su questo aspetto.

Le normative sull’utilizzo dell’Intelligenza Artificiale sono in costante evoluzione e subiscono frequenti modifiche per rispecchiare la natura dinamica della tecnologia dell’IA e dei quadri giuridici di riferimento. È quindi fondamentale che gli avvocati prestino particolare attenzione, si tengano aggiornati sui continui sviluppi del panorama normativo e adeguino di conseguenza le proprie prassi lavorative.

Inoltre, è consigliabile conoscere le eventuali normative nazionali o stabilite dagli Ordini Forensi, anche se non vincolanti. Infine, gli avvocati dovrebbero analizzare attentamente i Termini di servizio dei fornitori di GenAI, per assicurarsi che siano conformi alle normative deontologiche e legali.

In questo modo, gli avvocati possono garantire la massima qualità e professionalità nei loro servizi legali.

4) Integrare le competenze legali

La GenAI è uno strumento che può essere integrato alle competenze legali per semplificare le attività nello studio legale e migliorare l’efficienza dei servizi offerti.

Tuttavia, è importante ricordare che la GenAI non può sostituire il giudizio professionale, la capacità critica e la competenza del professionista. Pertanto, il suo utilizzo dovrebbe essere finalizzato ad un supporto nell’elaborazione di informazioni e nella gestione di attività, ma non come sostituzione delle competenze umane.

L’avvocato deve essere in grado di integrare le sue competenze legali con l’uso dell’intelligenza artificiale (IA), al fine di migliorare l’efficienza dei servizi offerti ai clienti. L’IA non può sostituire il giudizio e la competenza dell’avvocato, ma può essere utilizzata come un supporto aggiuntivo per semplificare alcune attività ripetitive e migliorare l’accuratezza delle analisi.

I risultati forniti dalla macchina dovrebbero sempre essere controllati autonomamente attraverso analisi, ricerche, verifiche dei fatti e giudizio professionale. È importante informare le persone sull’importanza di non affidarsi esclusivamente ai chatbot per le consulenze, poiché potrebbero essere insufficienti e comportare dei rischi. Esiste, infatti, il rischio che alcune persone scelgano di non rivolgersi a un legale perché ritengono sufficiente un consulto con un chatbot basato sugli LLM. È importante informare i clienti sui rischi associati all’affidarsi esclusivamente a questo tipo di pratica.

Esiste un rischio concreto che alcune persone scelgano di non consultare un avvocato, erroneamente ritenendo che una chatbot basata su LLM possa essere sufficiente. È di fondamentale importanza informare i clienti riguardo ai potenziali rischi che derivano dall’affidarsi esclusivamente a sistemi basati sull’intelligenza artificiale.

5) Assicurare il rispetto del segreto professionale

Quando si formulano domande alla macchina, è importante proteggere la riservatezza delle informazioni legate al segreto professionale. Ciò significa evitare di inserire direttamente o indirettamente i dati del cliente nelle prompt.

Occorre

1- Garantire il segreto professionale anche quando vengono utilizzati strumenti o piattaforme di intelligenza artificiale generativa.

2 – Prendere le precauzioni necessarie per proteggere la riservatezza delle informazioni e delle comunicazioni dei clienti.

3 – Assicurarsi che i sistemi di IA generativa che utilizzi dispongano di adeguate misure di sicurezza.

4 – Implementare le misure di sicurezza efficaci per salvaguardare i dati sensibili e rispettare gli obblighi deontologici e legali relativi alla riservatezza del cliente.

In base alle condizioni contrattuali o alle normative equivalenti, potrebbe non essere consentito inserire direttamente o indirettamente i dati del cliente come parte di un prompt nei sistemi GenAI. Questo a causa della possibile ulteriore elaborazione delle informazioni contenute nel prompt.

6) Garantire la protezione dei dati personali e della privacy

La protezione dei dati personali è diventata sempre più importante con l’avvento dell’intelligenza artificiale e la raccolta di grandi quantità di dati da parte di aziende e governi.

La raccolta e l’utilizzo improprio di informazioni personali possono avere conseguenze negative sulla privacy e la sicurezza delle persone coinvolte.

Le regole del GDPR devono essere rispettate con rigore. Secondo l’FBE, l’inserimento di dati personali nei sistemi di GenAI richiede una base giuridica adeguata e una valutazione in conformità alle norme sulla protezione dei dati e sulla privacy.

Si consiglia di effettuare un’attenta valutazione per verificare la conformità degli strumenti utilizzati al Regolamento generale sulla protezione dei dati (GDPR) al fine di garantire la sicurezza dei dati personali degli utenti.

In questo modo, è importante che gli avvocati e i professionisti del settore giuridico comprendano il rischio di violazione della privacy e proteggano i dati personali dei loro clienti.

Per garantire la protezione e la riservatezza dei dati personali, è fondamentale adottare misure di sicurezza adeguate che comprendano sia la tecnologia utilizzata che i processi coinvolti. Ciò permette di prevenire l’accesso, l’utilizzo o la divulgazione non autorizzati dei dati personali, garantendo la loro sicurezza e rispettando la normativa sulla privacy.

Per proteggere i dati personali nell’era dell’Intelligenza Artificiale, è fondamentale che le aziende e i governi adottino misure adeguate per garantire la sicurezza dei dati e per assicurare che questi siano utilizzati in modo etico e trasparente. Ciò può includere l’implementazione di robuste politiche di sicurezza dei dati, l’adozione di normative sulla privacy e il coinvolgimento degli utenti nella gestione dei propri dati personali. Inoltre, è importante che gli utenti siano informati sulle modalità di utilizzo dei loro dati e sui loro diritti in materia di privacy, al fine di consentire loro di prendere decisioni consapevoli sulla condivisione dei propri dati.

È importante ricordare che i generatori di testo non elaborano solo i dati per produrre risposte ai prompt, ma utilizzano anche questi dati per migliorare il sistema stesso. In altre parole, i dati inseriti diventano parte integrante del modello linguistico, contribuendo a migliorare la qualità delle risposte fornite. Questo processo è particolarmente importante ai fini della conformità al GDPR, in quanto garantisce che i dati degli utenti siano utilizzati in modo responsabile e trasparente.

7) Informare i clienti ed assumersi la responsabilità

Le linee guida raccomandano di comunicare con trasparenza ai propri clienti l’utilizzo della tecnologia GenAI nello studio legale.

È importante che il cliente sia informato circa lo scopo dell’utilizzo, i vantaggi, le limitazioni e le garanzie offerte, nonché il ruolo che la tecnologia svolge nella risoluzione delle questioni legali. Inoltre, l’avvocato è tenuto a assumersi la responsabilità degli esiti e delle conseguenze dell’utilizzo della GenAI di fronte al cliente.

È importante specificare se tali strumenti vengono utilizzati per ricerche legali o per altre attività, spiegando in maniera chiara il loro utilizzo, il loro scopo, i vantaggi e le limitazioni. In questo modo, i clienti saranno in grado di comprendere appieno il ruolo di questa tecnologia e le garanzie che essa offre.

Assumersi la responsabilità degli esiti e delle conseguenze dell’utilizzo della GenAI. All’interno dello studio legale occorre adottare un approccio responsabile verso l’utilizzo degli strumenti di GenAI. Informare tutti i collaboratori delle regole stabilite e assicurarsi che queste siano rispettate.

Conclusioni

“Spero che troverete questo rapporto non solo utile ma anche un catalizzatore per iniziative volte a sensibilizzare gli avvocati sull’uso responsabile dell’intelligenza artificiale generativa. Vi incoraggio a pianificare e coordinare iniziative in questo settore e la Commissione per le nuove tecnologie è pronta a fornire supporto in ogni modo possibile”, ha affermato Maria Dymitruk, Presidente della Commissione Nuove Tecnologie della FBE.

La Commissione ha espresso l’auspicio che le linee guida possano avviare una discussione globale sul quadro legale e deontologico dell’uso della GenAI in campo legale.

Gli avvocati sono invitati a considerare le raccomandazioni e a stimolare la discussione all’interno dei rispettivi Ordini Forensi, riflettendo sulla conformità alle regole deontologiche esistenti o in corso di adozione.

Anche se non esaustive, queste linee guida dovrebbero essere prese in considerazione come un passo importante verso la creazione di un ambiente di lavoro più affidabile e rispettoso delle normative.

Riteniamo che l’integrazione dell’IA generativa nella professione degli avvocati europei, seguendo queste linee guida, possa portare numerosi vantaggi.

Grazie all’utilizzo responsabile della tecnologia, gli avvocati potranno migliorare l’efficacia del loro lavoro, rispettando al contempo gli standard deontologici e garantendo la riservatezza dei clienti.

In questo modo, la professionalità della figura dell’avvocato rimarrà sempre elevata.

Occorre evidenziare che la rivoluzione attuale nel mondo del lavoro, guidata dall’uso diffuso di modelli linguistici di grandi dimensioni, può portare benefici anche alle professioni legali. Almeno questo è l’augurio principale

D’altronde le linee guida vogliono essere una bussola per gli avvocati che aspirano ad abbracciare queste tecnologie senza precedenti, pur aderendo ai requisiti professionali.

La tecnologia dell’Intelligenza Artificiale (AI), tuttavia, può comportare dei rischi per la società, quindi è necessario stabilire delle limitazioni e delle regole chiare per garantire la tutela dei diritti. Gli esperti sono preoccupati per il rischio etico legato alla mancanza di trasparenza degli algoritmi di AI.

Fino a quando non si conosce esattamente il funzionamento di questi algoritmi, non si può avere piena fiducia nella tecnologia e nei risultati che essa produce. Il rischio di bias, ovvero la presenza di pregiudizi e lacune nei dati utilizzati per addestrare gli algoritmi, rappresenta un altro problema.

Se i dati di addestramento sono sbilanciati, il sistema può produrre modelli altrettanto sbilanciati.

La giustizia predittiva?

Le nuove applicazioni dell’intelligenza artificiale e le prime esperienze nel settore giudiziario.

La Giustizia Predittiva: Un Futuro tra Algoritmi e Equità

Nel cuore pulsante dell’innovazione giuridica, la Francia sta disegnando i contorni di un futuro in cui la giustizia si fonde con la tecnologia. La giustizia predittiva non è più un argomento relegato ai romanzi di fantascienza o alle discussioni accademiche; è una realtà tangibile che sta rivoluzionando il modo in cui pensiamo all’amministrazione della giustizia.

L’Ascesa di Predictice e la Promessa di Efficienza

Immaginate un mondo in cui la previsione dell’esito di un processo civile possa essere affidata a un algoritmo. Predictice, lanciato nel 2016, sta trasformando questa visione in realtà. Attraverso l’analisi di migliaia di sentenze passate, Predictice promette una maggiore efficienza e oggettività, diventando un faro per gli operatori legali che cercano di navigare le complesse acque delle cause civili.

DataJust: L’Automazione Incontra l’Equità

DataJust segue le orme di Predictice, ma con un focus specifico sui risarcimenti per danni personali. Questo sistema non solo standardizza le compensazioni ma introduce una prevedibilità nelle decisioni giudiziarie che potrebbe essere la chiave per una maggiore equità. La Francia sta pionieristicamente esplorando come l’intelligenza artificiale possa ridurre il carico di lavoro dei tribunali e contribuire a un sistema più giusto.

I Benefici: Democratizzazione e Accessibilità

La prospettiva di democratizzare l’accesso alla giustizia attraverso la predittività è affascinante. L’abbattimento dei costi legali e la riduzione dei tempi dei processi sono obiettivi nobili che la giustizia predittiva potrebbe raggiungere, portando così a una maggiore obiettività nelle stime dei danni e nelle decisioni legali.

Le Sfide Etiche: Il Prezzo dell’Impersonalità

Tuttavia, non tutto ciò che luccica è oro. La trasparenza degli algoritmi e il rispetto della privacy sono preoccupazioni significative che emergono quando si parla di giustizia predittiva. Gli algoritmi potrebbero essere imparziali, ma sono anche impersonali. Come possiamo assicurarci che l’essenza dell’umanità non venga persa nel processo?

Il Dibattito Europeo e le Prospettive Future

Il dibattito non è confinato ai confini francesi; tutta l’Europa osserva con interesse. La Francia potrebbe essere la pioniera, ma il cammino verso una giustizia assistita dall’intelligenza artificiale è irta di domande etiche e legali che richiedono un attento bilanciamento tra innovazione e rispetto dei principi fondamentali della giustizia.

Conclusione: Verso un Futuro Equilibrato

L’integrazione dell’intelligenza artificiale nel sistema giudiziario francese è un passo coraggioso verso il futuro. Predictice e DataJust sono la prova che la tecnologia può assistere la legge, ma è essenziale procedere con saggezza. Dobbiamo assicurarci che l’imparzialità e l’equità, pilastri della giustizia, restino saldi anche nell’era digitale.

La giustizia predittiva è qui, ma dobbiamo chiederci: siamo pronti ad accoglierla con tutte le sue sfide e promesse? Il dibattito è aperto, e il futuro della giustizia sembra essere scritto in codice binario.

e nel nostro Paese?

Il Futuro della Giustizia attraverso l’Intelligenza Artificiale: Il Caso di Brescia

Nel panorama giudiziario italiano, la città di Brescia si è distinta per aver intrapreso un cammino innovativo nel campo della giustizia predittiva. Questa nuova frontiera, che si avvale dell’intelligenza artificiale (IA), mira a fornire previsioni sugli esiti e i tempi delle cause giudiziarie. Il progetto, nato dalla collaborazione tra la Corte di Appello e il Tribunale di Brescia con l’Università degli Studi di Brescia, è già attivo dal novembre 2021 e si concentra specificamente sul Diritto del lavoro e sul Diritto delle imprese.

L’obiettivo principale è quello di offrire maggiore certezza e prevedibilità agli utenti e agli operatori economici, contribuendo così a ridurre il numero di cause temerarie. Inoltre, il progetto punta a migliorare la trasparenza delle decisioni giudiziarie e a facilitare la circolazione della giurisprudenza tra i vari gradi di giudizio, superando in tal modo le discrepanze inconsapevoli.

Il sito web degli uffici giudiziari di Brescia offre già accesso a queste informazioni, delineando un quadro in cui l’IA non sostituisce il giudice ma funge da supporto nella gestione dei dati e nella previsione dei processi. La prospettiva è quella di estendere questa tecnologia a ulteriori rami del diritto, promuovendo un sistema giudiziario più efficiente e informato.

https://giustiziapredittiva.unibs.it/

Il caso Venezia

Innovazione e Giustizia: La Rivoluzione della Giurisprudenza Predittiva a Venezia

Venezia si conferma crocevia di innovazione con il lancio di un progetto pionieristico in campo giuridico: la giurisprudenza predittiva. Questa iniziativa, frutto della collaborazione tra l’Università Ca’ Foscari, la Corte di Appello di Venezia, Unioncamere del Veneto e Deloitte, mira a rivoluzionare il sistema legale attraverso l’uso dell’intelligenza artificiale.

La piattaforma sviluppata analizza le sentenze relative ai licenziamenti per giusta causa e giustificato motivo soggettivo, fornendo previsioni sull’esito dei giudizi. Questo strumento AI, basato su Natural Language Understanding & Processing, ha l’ambizioso obiettivo di ridurre i contenziosi infondati e migliorare la prevedibilità delle decisioni legali.

I dati raccolti nel triennio 2019-2021 sono stati inseriti nell’elaboratore, permettendo agli operatori legali di accedere a precedenti giurisprudenziali e di valutare le prospettive di successo delle cause. Il progetto non intende sostituire il giudizio umano ma offrire un supporto ausiliario per una giustizia più efficiente e informata.

L’iniziativa ha già mostrato risultati promettenti e si posiziona come un passo avanti significativo verso un futuro in cui la tecnologia e l’umanità collaborano per una maggiore equità e trasparenza nel sistema giudiziario.

Nel settore tributario

Prodigit: Una Rivoluzione nel Mondo della Giustizia Tributaria

La giustizia tributaria sta per compiere un grande salto in avanti grazie a Prodigit, un progetto innovativo che mira a introdurre l’intelligenza artificiale (IA) nel settore. Finanziato con 8 milioni di euro dal Programma Operativo Nazionale Governance e Capacità Istituzionale 2014-2020 e inserito nel Piano Nazionale di Ripresa e Resilienza (PNRR), Prodigit si pone l’obiettivo di trasformare la giustizia tributaria attraverso la giustizia predittiva.

Nonostante alcune incertezze sulla rapida attuazione del progetto, l’idea alla base è quella di utilizzare l’IA per creare riassunti astrattivi, che parafrasano in modo sintetico i contenuti delle sentenze, e riassunti estrattivi, che selezionano informazioni chiave dai testi originali. Questo processo non solo facilita l’estrazione di conoscenza dalle sentenze, ma getta anche le basi per un sistema predittivo capace di anticipare le decisioni in casi simili.

Il cuore di Prodigit è un database che raccoglie le informazioni necessarie per alimentare il sistema di sommarizzazione e, in futuro, quello predittivo. Tuttavia, l’uso dell’intelligenza artificiale nel diritto tributario solleva questioni etiche e rischi, come la possibilità di orientare gli operatori verso interpretazioni errate.

Nonostante questi rischi, le opportunità offerte dall’IA sono molteplici, soprattutto nel diritto tributario, che per la sua natura seriale e la relativa uniformità normativa si presta bene all’applicazione di sistemi intelligenti. Questi sistemi non sostituiranno il giudice ma serviranno come strumento di supporto per migliorare l’efficienza e la qualità delle decisioni.

In sintesi, Prodigit rappresenta un passo importante verso l’innovazione della giustizia tributaria. Sebbene ci siano sfide da superare, il potenziale di miglioramento nella gestione dei casi tributari è significativo, promettendo una giustizia più rapida, accurata e prevedibile.

Applicazioni di Intelligenza Artificiale per la previsione nel settore penale

L’Intelligenza Artificiale nella Giustizia Penale: Un’Arma a Doppio Taglio?

L’avvento dell’intelligenza artificiale (IA) ha trasformato numerosi settori della società, e la giustizia penale non fa eccezione. Mentre l’IA promette di rivoluzionare il modo in cui vengono condotte le indagini e gestiti i processi, solleva anche questioni etiche e legali significative che non possono essere ignorate.

Prevenzione della Criminalità: Il Potenziale dell’IA