La ISO/IEC 42001:2023 rappresenta il primo standard internazionale per la gestione responsabile dell’intelligenza artificiale, fornendo una guida preziosa per affrontare le sfide uniche poste da questa tecnologia in rapida evoluzione, come considerazioni etiche, trasparenza e apprendimento continuo.Inserisci sezione

Governance dell’AI: Requisiti e Vantaggi

Modifica

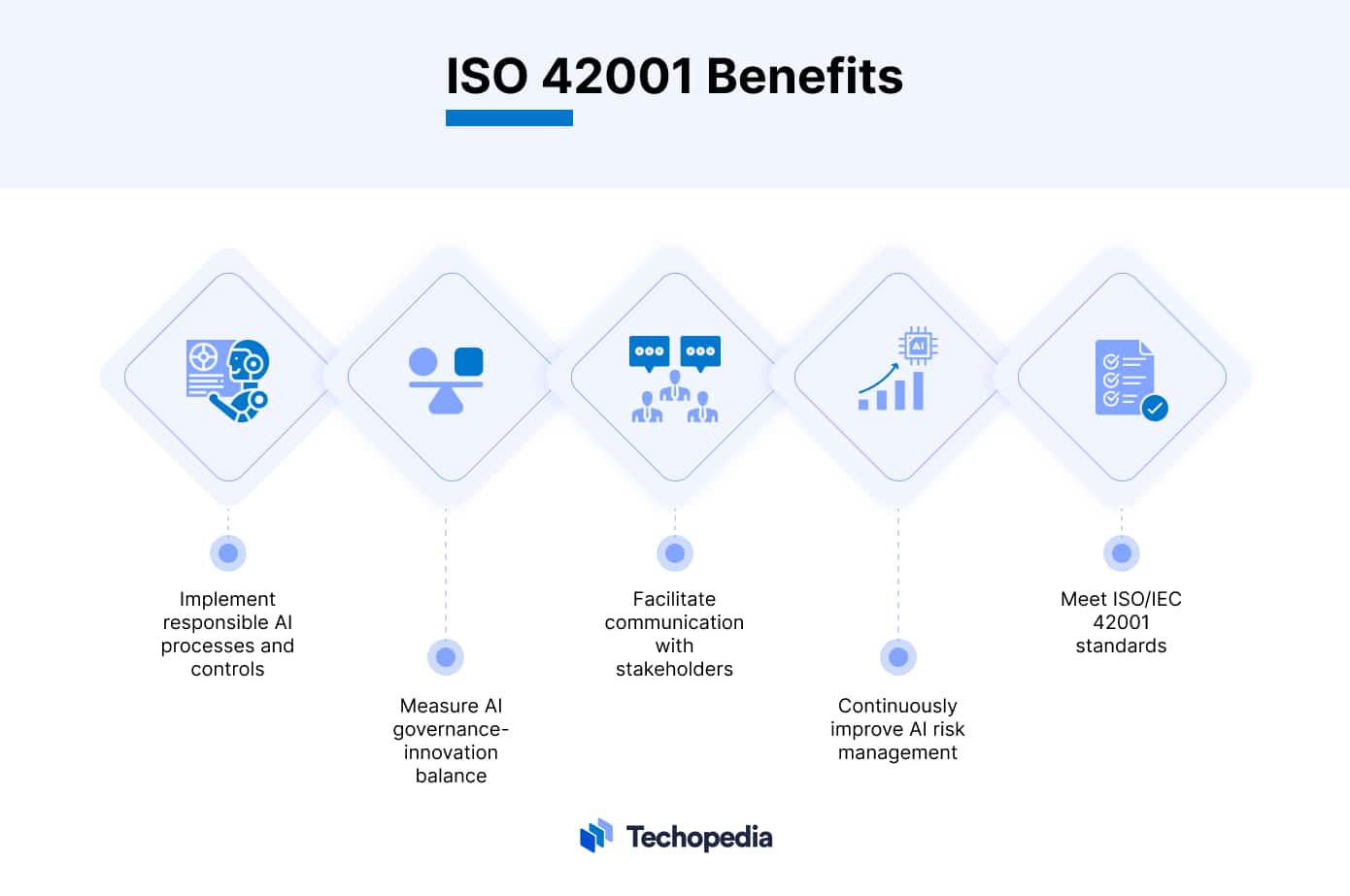

Vantaggi dell’adozione dello standard ISO/IEC 42001L’adozione dello standard ISO/IEC 42001 offre numerosi vantaggi alle organizzazioni che sviluppano o utilizzano sistemi di intelligenza artificiale:

- Miglioramento della qualità, sicurezza e affidabilità delle applicazioni di IA : Lo standard fornisce linee guida per garantire che i sistemi di IA siano progettati, sviluppati e implementati in modo sicuro, trasparente e affidabile, riducendo il rischio di errori, bias o comportamenti imprevisti.

- Maggiore fiducia nei sistemi di IA : Seguendo i principi dello standard, le possono organizzazioni dimostrano il loro impegno verso un utilizzo etico e responsabile dell’IA, aumentando la fiducia dei clienti, dei regolatori e del pubblico.

- Conformità normativa : L’ISO/IEC 42001 aiuta le organizzazioni ad allinearsi con le normative emergenti sull’IA, come l’AI Act dell’UE, attraverso controlli specifici, schemi di audit e linee guida coerenti.

- Riduzione dei costi di sviluppo dell’IA : Adottando un approccio strutturato per la gestione dei rischi e la valutazione dell’impatto, le organizzazioni possono evitare errori costosi o ritardi nello sviluppo di soluzioni di IA.

- Opportunità di innovazione responsabile : Lo standard incoraggia le organizzazioni a identificare e sfruttare le opportunità legate all’IA, minimizzando al contemporaneo i rischi associati e garantendo un utilizzo etico e sostenibile.

- Miglioramento continuo : Il ciclo PDCA (Plan-Do-Check-Act) alla base dell’ISO/IEC 42001 promuove un processo di miglioramento continuo, consentendo alle organizzazioni di adattare proattivamente il loro approccio all’IA man mano che la tecnologia si evolve.

In sintesi, l’adozione dello standard ISO/IEC 42001 consente alle organizzazioni di sfruttare al meglio il potenziale dell’intelligenza artificiale in modo sicuro, etico e sostenibile, mitigando i rischi e promuovendo l’innovazione responsabile.

Valutazione e mitigazione dei rischi

Gestione dei rischi dell’IALa gestione dei rischi è un elemento cruciale per un utilizzo responsabile dell’intelligenza artificiale, come evidenziato dallo standard ISO/IEC 42001. I sistemi di IA possono presentare rischi unici legati alla loro complessità, mancanza di trasparenza e capacità di apprendimento continuo.

Lo standard richiede alle organizzazioni di condurre valutazioni periodiche dei rischi legati all’IA e di definire attività di trattamento del rischio proporzionate al livello di rischio identificato.

Questo processo iterativo dovrebbe considerare diversi fattori di rischio, tra cui:

- Rischi tecnici : Errori, bias, instabilità o vulnerabilità dei modelli di IA che potrebbero portare a risultati imprevisti o dannosi.

- Rischi di sicurezza : Potenziali minacce come attacchi informatici, manomissione dei dati o violazione della privacy.

- Rischi etici e sociali : Discriminazioni, violazioni dei diritti umani, impatti negativi sulla società o sull’ambiente.

- Rischi legali e di compliance : Mancato rispetto delle normative vigenti o delle linee guida etiche.

- Rischi operativi : Interruzioni di servizio, perdite finanziarie o danni alla reputazione aziendale.

Per gestire efficacemente questi rischi, lo standard raccomanda l’implementazione di controlli adeguati, come test rigorosi, monitoraggio continuo, misure di sicurezza, formazione del personale e processi di governance solidi.

Inoltre, l’ISO/IEC 42001 promuove la trasparenza e la spiegabilità dei sistemi di IA, consentendo alle organizzazioni di comprendere meglio il funzionamento dei loro algoritmi e di identificare potenziali problemi o bias.Una gestione efficace dei rischi dell’IA non solo protegge le organizzazioni dalle conseguenze negative, ma promuove anche la fiducia del pubblico e la conformità normativa, facilitando un’adozione responsabile e sostenibile di questa tecnologia rivoluzionaria.

Governance e Compliance dell’IA

Governance e Compliance dell’IALa governance e la compliance sono elementi cruciali per un utilizzo responsabile e sostenibile dell’intelligenza artificiale all’interno delle organizzazioni.

Lo standard ISO/IEC 42001 fornisce linee guida specifiche per stabilire un solido sistema di governance dell’IA, garantendo il rispetto delle normative vigenti e dei principi etici.Governance dell’IALa governance dell’IA si riferisce a un sistema di regole, pratiche, processi e strumenti tecnologici in grado di garantire un utilizzo dell’IA in linea con le strategie, gli obiettivi ei valori dell’organizzazione, soddisfacendo i requisiti di compliance e di etica .

Questo sistema dovrebbe coinvolgere diverse figure chiave, come data scientist, manager, legali, esperti di sicurezza e rappresentanti degli stakeholder.Alcuni elementi chiave della governance dell’IA includono:

- Definizione di politiche e linee guida : Stabilire principi guida, codici di condotta e processi decisionali per l’utilizzo dell’IA, allineati con i valori aziendali e le normative vigenti.

- Strutture di governance : Creare team multidisciplinari e comitati di governance per supervisionare lo sviluppo e l’implementazione dell’IA, valutare i rischi e garantire la conformità.

- Monitoraggio e revisione : implementare processi di monitoraggio continuo e revisione periodica dei sistemi di IA, per identificare potenziali problemi, bias o derivare nel tempo.

- Trasparenza e spiegabilità : Promuovere la trasparenza e la spiegabilità dei sistemi di IA, consentendo alle organizzazioni di comprendere il funzionamento degli algoritmi e di identificare potenziali problemi o bias.

Conformità NormativaLa compliance normativa è un aspetto fondamentale della governance dell’IA, poiché le organizzazioni devono garantire che i loro sistemi di IA rispettino le leggi ei regolamenti applicabili. Esempi di normative rilevanti includono il GDPR per la protezione dei dati personali, l’AI Act dell’UE per la regolamentazione dei sistemi di IA ad alto rischio, e le leggi antidiscriminazione.Le organizzazioni dovrebbero adottare misure come valutazioni di impatto, audit di conformità, gestione dei rischi e formazione del personale per garantire il rispetto delle normative vigenti. Inoltre, è importante monitorare costantemente l’evoluzione del panorama normativo e adattare di conseguenza le politiche ei processi di governance dell’IA.Una solida governance e compliance dell’IA non solo protegge le organizzazioni dalle potenziali conseguenze legali e reputazionali, ma promuove anche la fiducia del pubblico e facilita un’adozione responsabile e sostenibile di questa tecnologia rivoluzionaria.

Dati affidabili per l’IA

Qualità e affidabilità dei dati per l’IALa qualità e l’affidabilità dei dati sono fattori cruciali per il successo delle applicazioni di intelligenza artificiale (IA).

I sistemi di IA si basano sui dati per l’addestramento dei modelli e la generazione di output, rendendo la qualità dei dati un prerequisito fondamentale per risultati accurati e affidabili.

Importanza della qualità dei datiI dataset di scarsa qualità possono portare a risultati imprecisi, bias e decisioni errate da parte dei sistemi di IA. Alcuni problemi comuni legati alla qualità dei dati includono:

- Dati incompleti o mancanti : Lacune nei dati possono causare una rappresentazione parziale della realtà, portando a modelli imprecisi.

- Dati non accurati o errati : Errori nei dati possono propagarsi e amplificarsi durante l’addestramento dei modelli di IA.

- Dati non rappresentativi : Se i dati non riflettono adeguatamente la diversità del mondo reale, i modelli possono essere soggetti a bias e non generalizzare correttamente.

- Dati obsoleti o non aggiornati : I dati devono essere aggiornati per riflettere le condizioni attuali e garantire risultati rilevanti.

Affidabilità dei datiL’affidabilità dei dati è un altro aspetto cruciale per l’IA. I dati devono essere coerenti, verificabili e provenienti da fonti attendibili. Lo standard ISO/IEC 42001 sottolinea l’importanza di garantire l’integrità, la consistenza e la completezza dei dati utilizzati per l’IA.Miglioramento della Qualità e dell’Affidabilità dei DatiPer affrontare le sfide legate alla qualità e all’affidabilità dei dati, le organizzazioni possono adottare diverse strategie:

- Governance dei dati : Implementare processi di governance dei dati per garantire la qualità, la sicurezza e la conformità dei dati utilizzati per l’IA.

- Pulizia e pre-elaborazione dei dati : Applicare tecniche di pulizia dei dati, come la rimozione di valori anomali, la gestione dei valori mancanti e la normalizzazione dei dati.

- Annotazione e verifica dei dati : Coinvolgere esperti umani per annotare e verificare la qualità dei dati, soprattutto per applicazioni di IA ad alto rischio.

- Standard e linee guida : Adottare standard e linee guida riconosciute a livello internazionale, come le norme ISO/IEC, per garantire la qualità e l’affidabilità dei dati.

- Formazione e sensibilizzazione : Formare il personale sulla gestione dei dati e sull’importanza della qualità dei dati per l’IA.

Investire nella qualità e nell’affidabilità dei dati è fondamentale per sfruttare al massimo il potenziale dell’IA e garantire risultati accurati, equi e affidabili. Lo standard ISO/IEC 42001 fornisce una guida preziosa per affrontare questa sfida critica.

Gestione responsabile dell’IA

Requisiti dell’ISO/IEC 42001:2023 per un Sistema di Gestione dell’IA

La norma ISO/IEC 42001:2023 definisce i requisiti fondamentali per stabilire, implementare, mantenere e migliorare continuamente un sistema di gestione dell’intelligenza artificiale (AIMS) all’interno di un’organizzazione. Tra i principali requisiti specificati, si evidenziano:

- Contesto dell’organizzazione : Comprendere il contesto interno ed esterno in cui opera l’organizzazione, identificando le parti interessate ei loro requisiti relativi all’IA.

- Leadership e impegno : La direzione deve dimostrare leadership e impegno verso il sistema di gestione dell’IA, definendo politiche, ruoli, responsabilità e processi decisionali.

- Pianificazione : Stabilire obiettivi, valutare i rischi e le opportunità associati all’IA, e pianificare le azioni necessarie per affrontarli in modo sistematico.

- Supporto e operatività : Garantire le risorse adeguate, comprese competenze, consapevolezza, comunicazione e informazioni documentate per un efficace sistema di gestione dell’IA.

- Attività operativa : Implementare controlli e processi per la progettazione, lo sviluppo, la formazione, il test e la manutenzione dei sistemi di IA in modo etico e responsabile.

- Valutazione delle prestazioni : monitorare, misurare, analizzare e valutare le prestazioni del sistema di gestione dell’IA, inclusa la conformità ai requisiti legali e normativi.

- Miglioramento continuo : identificare e selezionare opportunità di miglioramento, nonché attuare le azioni necessarie per migliorare l’efficacia del sistema di gestione dell’IA.

Questi requisiti sono progettati per aiutare le organizzazioni a gestire in modo efficace e responsabile i sistemi di IA, garantendo la conformità ai requisiti normativi, etici e di sicurezza, nonché promuovendo la trasparenza, l’equità e la fiducia del pubblico.

Orientamenti per l’implementazione e il miglioramento continuo

La norma ISO/IEC 42001:2023 fornisce linee guida dettagliate per implementare e migliorare continuamente un sistema di gestione dell’IA efficace, tra cui:

- Approccio basato sul rischio : Adottare un approccio basato sul rischio per identificare, valutare e trattare i rischi associati all’IA in modo sistematico e proattivo.

- Ciclo di vita dell’IA : Considerare l’intero ciclo di vita dei sistemi di IA, dalla progettazione allo sviluppo, all’implementazione e al monitoraggio continuo.

- Coinvolgimento delle parti interessate : Coinvolgere attivamente le parti interessate rilevanti, come clienti, dipendenti e comunità, per comprendere le loro aspettative e preoccupazioni riguardo all’IA.

- Trasparenza e spiegabilità : Promuovere la trasparenza e la spiegabilità dei sistemi di IA, consentendo alle organizzazioni di comprendere il funzionamento degli algoritmi e di identificare potenziali problemi o bias.

- Formazione e sensibilizzazione : Fornire formazione e sensibilizzazione adeguata al personale coinvolto nella gestione dei sistemi di IA, promuovendo una cultura di responsabilità e consapevolezza.

- Monitoraggio e revisione : implementare processi di monitoraggio continuo e revisione periodica dei sistemi di IA, per identificare potenziali problemi, bias o derivare nel tempo.

- Miglioramento continuo : Adottare un approccio di miglioramento continuo, analizzando i dati raccolti, valutando l’efficacia delle azioni intraprese e apportando le modifiche necessarie al sistema di gestione dell’IA.

Seguendo questi orientamenti, le organizzazioni possono e costantemente un sistema di gestione dell’IA solido, adattabile e migliorare conforme ai requisiti normativi e alle migliori pratiche.

Impatto dell’ISO/IEC 42001:2023 nel settore IT e dell’IA

L’ISO/IEC 42001:2023 ha avuto un impatto significativo nel settore della tecnologia dell’informazione e dell’intelligenza artificiale, fornendo uno standard globale per la gestione responsabile dei sistemi di IA. Tra gli impatti principali, si possono citare:

- Standardizzazione delle pratiche di gestione dell’IA : Lo standard ha contribuito a standardizzare e unificare l’approccio alla gestione dei sistemi di IA, colmando le lacune normative esistenti in questo settore in rapida evoluzione.

- Promozione di pratiche etiche e responsabilità : L’ISO/IEC 42001:2023 ha promosso l’adozione di pratiche etiche e responsabilità nell’implementazione e nel monitoraggio dei sistemi di IA, contribuendo a costruire sistemi più affidabili e trasparenti.

- Aumento della fiducia del pubblico : Seguendo i principi dello standard, le organizzazioni possono dimostrare il loro impegno verso un utilizzo etico e responsabile dell’IA, aumentando la fiducia dei clienti, dei regolatori e del pubblico.

- Conformità normativa : Lo standard ha fornito un quadro di riferimento per la conformità normativa, aiuta le organizzazioni ad allinearsi con le normative emergenti sull’IA, come l’AI Act dell’UE.

- Riduzione dei rischi e dei costi : Adottando un approccio strutturato per la gestione dei rischi e la valutazione dell’impatto, le organizzazioni possono evitare costosi errori o ritardi nello sviluppo di soluzioni di IA.

- Promozione dell’innovazione responsabile : L’ISO/IEC 42001:2023 ha incoraggiato le organizzazioni a identificare e sfruttare le opportunità legate all’IA, minimizzando al contemporaneo i rischi associati e garantendo un utilizzo etico e sostenibile.

Complessivamente, l’ISO/IEC 42001:2023 ha svolto un ruolo cruciale nel promuovere la governance e il controllo efficace dei sistemi di intelligenza artificiale, contribuendo a plasmare il futuro di questa tecnologia in modo responsabile e sostenibile nel settore IT e dell’IA.

Requisiti per l’IA Responsabile

Contenuti Principali dell’ISO/IEC 42001:2023

- Ambito di applicazione : Specifica i requisiti per un sistema di gestione dell’intelligenza artificiale (IA), applicabile a qualsiasi organizzazione che fornisce o utilizza prodotti o servizi basati su sistemi di IA, indipendentemente dalle dimensioni, tipo e natura dell’organizzazione.

- Riferimenti Normativi : Elenca i documenti normativi citati, come ISO/IEC 22989:2022 “Tecnologia dell’informazione – Intelligenza artificiale – Concetti di intelligenza artificiale e terminologia”.

- Termini e Definizioni : Definisce termini chiave come “organizzazione”, “parte interessata”, “sistema di gestione”, “rischio”, “intelligenza artificiale”, “sistema di IA”, ecc. per garantire una comprensione coerente.

- Contesto dell’Organizzazione : Descrive la necessità di comprendere l’organizzazione e il suo contesto, le esigenze e aspettative delle parti interessate, e la determinazione dell’ambito del sistema di gestione dell’IA.

- Leadership : Evidenzia l’importanza della leadership e dell’impegno della direzione, la definizione di una politica di IA, e l’assegnazione di ruoli, responsabilità e autorità appropriate.

- Pianificazione : Include azioni per affrontare rischi e opportunità associati all’IA, la valutazione del rischio di IA, il trattamento del rischio, e la valutazione dell’impatto del sistema di IA.

- Supporto : Copre le risorse, le competenze, la consapevolezza, la comunicazione e le informazioni documentate necessarie per un efficace sistema di gestione dell’IA.

- Operazione : Descrive la pianificazione e il controllo operativo, la valutazione del rischio di IA, il trattamento del rischio, e la valutazione dell’impatto del sistema di IA durante le fasi operative.

- Valutazione delle Prestazioni : Include il monitoraggio, la misurazione, l’analisi e la valutazione delle prestazioni del sistema di gestione dell’IA, gli audit interni e la revisione della gestione.

- Miglioramento : Si concentra sul miglioramento continuo del sistema di gestione dell’IA, sulla gestione delle non conformità e sulle azioni correttive.

Allegati

- Allegato A : Fornisce obiettivi di controllo e controlli di riferimento per la gestione dell’IA.

- Allegato B : Guida all’implementazione dei controlli dell’IA descritti nell’Allegato A.

- Allegato C : Descrive potenziali obiettivi organizzativi e fonti di rischio legati all’utilizzo dell’IA.

- Allegato D : Discutere l’uso del sistema di gestione dell’IA in diversi domini o settori specifici.

Importanza del documento

L’ISO/IEC 42001:2023 è un documento cruciale per aiutare le organizzazioni a gestire responsabilmente i sistemi di intelligenza artificiale, affrontando questioni chiave come la trasparenza, la sicurezza, l’affidabilità e l’impatto sociale dei sistemi di IA.Fornisce un quadro strutturato per integrare le pratiche di gestione dell’IA con altri standard di gestione esistenti, migliorando così la coerenza e l’efficacia complessiva del sistema di gestione dell’IA all’interno dell’organizzazione.Adottando questo standard, le organizzazioni possono dimostrare il loro impegno verso un utilizzo etico e responsabile dell’IA, aumentando la fiducia dei clienti, dei regolatori e del pubblico in generale.